"Độc dược"

Một nhóm các nhà nghiên cứu tại Đại học Chicago mới đây đã ra mắt Nightshade 1.0, một công cụ nhằm ngăn chặn việc sử dụng trái phép các tác phẩm nghệ thuật trong huấn luyện trí tuệ nhân tạo (AI).

Nightshade - được đặt theo Deadly Nightshade/Atropa belladonna, một loại cà độc dược có thể gây chết người nhưng cũng được dùng làm thuốc - và là công cụ đầu độc dữ liệu đầu vào AI mang tính tấn công, đi kèm với công cụ phòng thủ có tên Glaze.

Nightshade hoạt động bằng cách thêm các đối tượng không liên quan vào các tệp hình ảnh, làm giảm chất lượng của AI hướng ảnh được huấn luyện trên chúng.

Gần đây các nhà nghiên cứu đã phát triển ra Ai-Da, robot đầu tiên có thể vẽ như một họa sĩ dựa trên AI.

Những người chịu trách nhiệm về dự án cho biết: "Nightshade được tính toán như một sự tối ưu hóa đa mục tiêu nhằm giảm thiểu những thay đổi có thể nhìn thấy đối với hình ảnh gốc.

Ví dụ, mắt người có thể nhìn thấy hình ảnh bóng mờ của một con bò trên cánh đồng xanh gần như không thay đổi, nhưng AI có thể nhìn thấy một chiếc túi da lớn nằm trên cỏ".

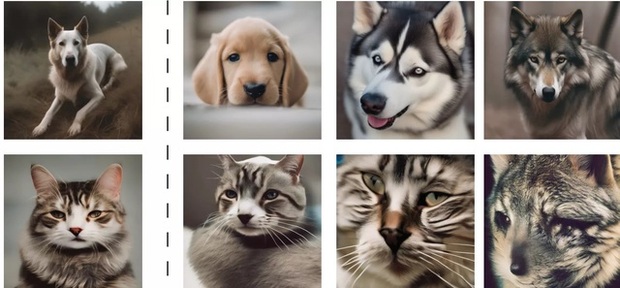

Nightshade cũng "đầu độc" hình ảnh liên quan đến các label/nhãn mà AI thường chọn (ví dụ: cat/mèo) bằng cách làm mờ ranh giới của khái niệm đó.

Kết quả là nếu người dùng đưa ra lời nhắc "cat" cho AI được đào tạo dựa trên hình ảnh bị Nightshade "hạ độc", họ sẽ nhận được hình ảnh liên quan tới một chú chó hoặc một con cá.

Những phản hồi không thể đoán trước được kiểu này sẽ làm giảm hiệu quả của AI và những người huấn luyện sẽ phải tìm cách thay thế dữ liệu đầu vào từ các nguồn miễn phí.

Ví dụ về cách Nightshade "hạ độc" các label "cat".

Nhóm nghiên cứu cũng nhấn mạnh:

"Nightshade có thể cung cấp một công cụ mạnh mẽ để chủ sở hữu nội dung bảo vệ tài sản trí tuệ của họ trước những người huấn luyện AI coi thường hoặc bỏ qua các thông báo bản quyền..."

Cần lưu ý rằng một số vụ kiện và khiếu nại của các nghệ sĩ đã được đưa ra trong thời gian gần đây nhằm vào Stability AI, Deviant Art, Midjourney và Runway AI - những đơn vị bị cáo buộc sử dụng các tác phẩm của các nghệ sĩ mà không được phép để huấn luyện AI.

Tuy nhiên các nhà nghiên cứu cũng cảnh báo rằng Nightshade cũng có một số hạn chế. Cụ thể, hình ảnh sau khi được xử lý có thể khác một chút so với ảnh gốc, đặc biệt là tác phẩm nghệ thuật sử dụng màu phẳng và nền mịn.

Ngoài ra, nhóm nghiên cứu cũng nhận thấy rằng các kỹ thuật hoàn tác những hình ảnh đã được Nightshade xử lý có thể được các bên khác phát triển.

Hình minh họa.

"Tráng men"

Glaze (Tráng men) hiện đã có phiên bản 1.1.1 vào tháng 6/2023.

Công cụ phòng thủ này thay đổi hình ảnh để ngăn AI sao chép phong cách của các nghệ sĩ. Nhóm nghiên cứu tin rằng các nghệ sĩ nên có cách ngăn chặn việc nắm bắt và tái tạo phong cách hình ảnh của họ:

"Việc bắt chước phong cách tạo ra một số kết quả có hại mà thoạt nhìn có thể không rõ ràng.

Đối với những nghệ sĩ có phong cách bị cố ý sao chép, họ không chỉ bị mất tiền hoa hồng và thu nhập cơ bản mà các bản sao tổng hợp chất lượng thấp rải rác trên mạng làm loãng thương hiệu và danh tiếng của họ.

Quan trọng nhất, việc bắt chước phong cách với các nghệ sĩ tương đương với hành vi trộm cắp danh tính và nếu điều này tiếp tục, nó sẽ khiến các nghệ sĩ giảm bớt tham vọng tạo ra tác phẩm mới".

Nhóm nghiên cứu cũng khuyến nghị các nghệ sĩ nên sử dụng cả Nightshade và Glaze. Hiện tại, hai công cụ này phải được tải xuống và cài đặt riêng biệt nhưng phiên bản kết hợp đang được phát triển.

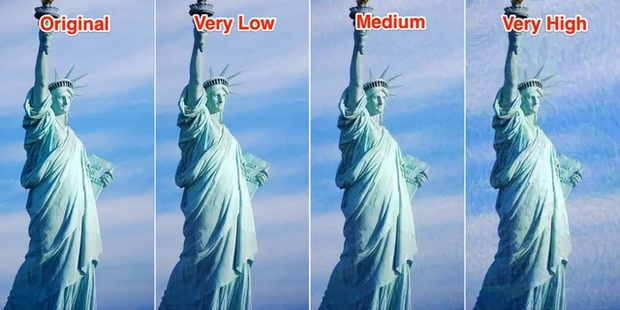

Các cấp bảo vệ của Glaze có thể anh hưởng ít nhiều đến ảnh.