Ngày nay, các công nghệ nhận diện, biến đổi và thay thế gương mặt càng lúc càng trở nên phổ biến hơn. Từ trước tới nay, chúng chủ yếu được sử dụng vào mục đích bảo mật là chính. Thế nhưng, giờ đây nó đã bắt đầu áp dụng vào mục đích giải trí, thậm chí là cả với mục đích là làm "phim người lớn".

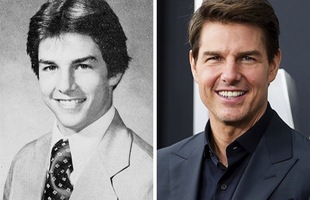

Một trong những ví dụ điển hình và nổi tiếng nhất của việc này chính là công nghệ thay đổi gương mặt có tên "Deepfake". Nhờ vào sức mạnh công nghệ trí tuệ nhân tạo, máy tinh sẽ quét video và ảnh chân dung của một người. Sau đó, máu tính sẽ bắt đầu thay thế chi tiết trên gương mặt như mắt, miệng khiến cho người trong video giống hệt người ở ngoài đời thực với độ chính xác cực kỳ cao. Dù chỉ mới xuất hiện trong thời gian gần đây, nó đã gây ra mối hoang mang lớn cho nhiều người và khiến các chuyên gia phải lên tiếng cảnh báo mọi người không nên lạm dụng công nghệ này.

Tuy nhiên, đối với những kẻ thích giả mạo của người nổi tiếng, Deepfake chính là một mảnh đất vàng. Bất kỳ ai cũng có thể biến bức ảnh, bản ghi âm, video thành những đoạn phim giả mạo như công cụ để truyền bá những thông tin sai lệch. Không chỉ các ca sĩ và người nổi tiếng đến từ thế giới phương Tây, giờ đây đến lượt các idol nữ K-pop cũng đã bắt đầu bị lợi dụng tên tuổi nhằm kiếm tiền. Một số nạn nhân điển hình có thể kể tới như Red Velvet, TWICE, SNSD, IU, AOA, Suzy, Chungha, GFRIEND, Apink, Girl’s Day, v.v...

Đây là hình thức quấy rối tình dục bằng công nghệ rất tinh vi mà pháp luật chưa thể kiểm soát được. Thậm chí, chúng còn bắt đầu xuất hiện công khai trên Youtube, còn ở những trang web 18+ dành cho người lớn thì có trời mới biết điều gì đã xảy ra. Với những người ít thông tin hay thiếu hiểu biết, họ hoàn toàn có thể bị đánh lừa rằng các nghệ sĩ chân chính đã chuyển qua làm phim người lớn như thật. Còn với các fan ruột, đây là điều khiến họ rất bức xúc và lo lắng. Họ mong muốn các công ty quản lý nhanh chóng đưa ra hình thức xử lý để bảo vệ hình tượng của các nữ nghệ sĩ này.